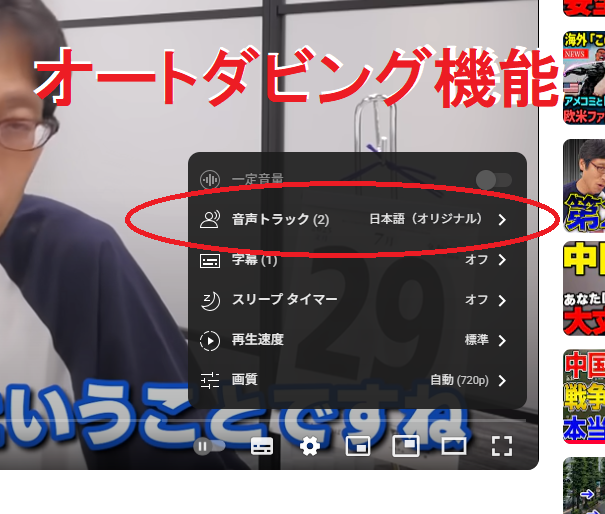

YouTube「オートダビング機能」使い方と注意点は?

1. 言語の指定はいくつまで可能か?

2. 音声が正しく翻訳・吹き替えされているかの確認方法はあるか?

本記事では、実際の運用で役立つ設定・確認の手順と、精度の注意点、さらに教育・記憶術・映像合成への応用までを整理します。

① 言語の指定は何言語まで可能か?

オートダビングは、配信者が任意の数を自由指定するというより、システムが対応する言語ペアに基づいて自動生成されます。

・元音声が英語の場合:日本語・スペイン語・ポルトガル語・フランス語・ドイツ語・イタリア語・ヒンディー語・インドネシア語など、最大8言語に吹き替えが生成される可能性があります。

・元音声が上記以外の言語(例:日本語・スペイン語など)の場合:現状では英語への吹き替えが中心です。

・したがって、配信者側が「20言語」などと数を任意指定する仕様ではなく、実運用上の上限は「最大8言語(+元音声)」と考えるのが実務的です。

② 吹き替え(翻訳)の正しさは確認できる?

クリエイター側の確認手順(YouTube Studio)

・公開前レビューを有効化:チャンネル設定で「公開前に吹き替えを手動確認」をオンにすれば、各言語の音声を公開前に試聴・審査できます(全言語/試験運用のみなどを選択可能)。

・生成後のプレビュー:YouTube Studioの「コンテンツ」→「言語」から、言語ごとにプレビュー再生が可能。

・公開/非公開/削除:問題がある吹き替えは非公開化したり、削除できます(動画単位・言語単位で管理)。

精度に関する注意点

・音声認識~翻訳~合成音声までのパイプライン上で、固有名詞や慣用句・専門用語は誤訳・不自然訳が発生しがち。

・話者の感情・トーンが十分に反映されない場合があります(特に皮肉・比喩・ニュアンス)。

・字幕と異なり音声として提示されるため、わずかな不自然さも目立ちやすい点に注意。

・重要回はネイティブ話者の試聴チェックを併用すると安心です。

教育・創作・記憶術への応用

・多重符号化:映像(視覚)+吹き替え音声(聴覚)の二重刺激は、学習記憶の定着を助けます。

・意味強調:重要語の字幕・テロップ・色分け(3M:Masking/Marking/Motion)と吹き替えを同期し、検索手がかりを一致させると想起が楽になります。

・反転学習:学習者自身に誤訳・不自然訳を見つけさせ、より適切な訳語を提案させる活動は、意味記憶の形成に有効です。

深堀用語(学術メモ)

・符号化特異性原理(Encoding Specificity Principle):学習時の文脈と再生時の手がかりが一致すると想起が容易。映像上の視覚手がかりと吹き替え音声の整合が鍵。

・多重符号化理論(Dual Coding Theory):言語情報とイメージ情報を併用すると記憶定着が強化される。

・場所法(Method of Loci):視空間イメージと連結する記憶法。シーン内の位置・動きと用語を紐づけると再生効率が上がる。

まとめ表(運用の勘所)

| 項目 | 内容 |

|---|---|

| 言語数の指定 | 配信者が任意指定する仕様ではない。英語→最大8言語、その他→主に英語への吹き替え。 |

| 事前確認 | 公開前レビューをオンにして各言語を試聴。問題があれば非公開・削除。 |

| 精度注意 | 固有名詞・慣用句・専門用語・感情トーンで誤訳・不自然訳が発生しやすい。 |

| 応用 | 多重符号化(視覚+聴覚)、3M(Masking/Marking/Motion)、反転学習で記憶定着を強化。 |